消費升級趨勢不減,數字化轉型提速——解讀京東《2021年消費現象及產業洞察報告》

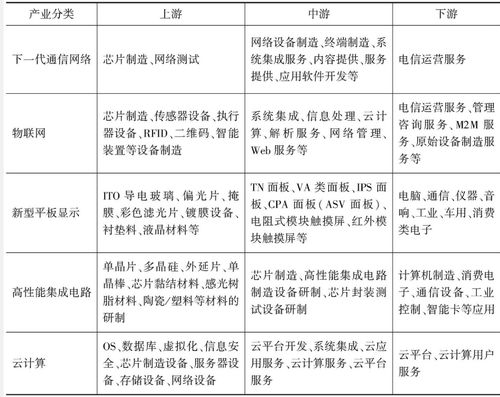

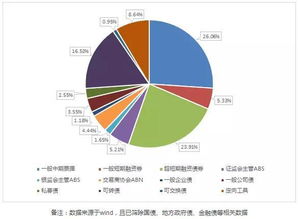

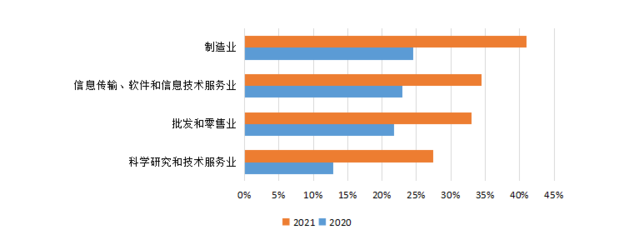

京東發布了《2021年消費現象及產業洞察報告》,報告聚焦于消費升級的持續動力和數字化轉型的加速推進,特別關注信息技術服務業在這一進程中的關鍵作用。報告顯示,2021年,盡管全球經濟面臨不確定性,但中國消費升級趨勢依然強勁,消費者對高品質、個性化和智能化產品的需求不斷增長。與此數字化轉型在各行各業中全面提速,企業通過數字化工具優化供應鏈、提升用戶體驗,推動了產業效率的整體提升。信息技術服務業作為數字化轉型的核心支撐,在云計算、大數據、人工智能等領域發揮了關鍵作用,幫助零售、制造等行業實現智能化升級。報告指出,隨著5G、物聯網等新技術的普及,消費升級和數字化轉型將進一步融合,為經濟高質量發展注入新動能。京東作為電商平臺,其自身實踐也印證了這一趨勢,通過技術創新賦能產業鏈,實現了消費者與企業雙贏。

如若轉載,請注明出處:http://www.huiyinpp3zc.cn/product/47.html

更新時間:2026-04-18 06:17:41